Künstliche Intelligenz und die Zukunft der Gesellschaften

Bei der Herrenhäuser Konferenz "AI and the Future of Societies" vom 12. bis 14. Oktober 2022 beleuchteten Forschende die Auswirkung von KI auf die Gesellschaft. Eine kritische Betrachtung des Themas von Mathias Greffrath.

I.

"Es besteht kein Zweifel, dass der Mensch eine Maschine herstellen könnte, die im Stande wäre, sich eine Zeit lang durch eine Stadt umherzubewegen und genau um bestimmte Straßenecken zu biegen (…) und ein Schiff, das (…) im Stand wäre, ganz allein einem bestimmten Hafen zuzusteuern". Für Gottfried Wilhelm Leibniz bestand kein Zweifel daran, "daß der Mensch auch einen Körper bilden könnte, der fähig wäre, einen Menschen nachzuahmen", oder dass man das "Alphabet der menschlichen Gedanken" mathematisieren könnte.

Was der Universalgelehrte 1696 dachte, wirkt heute in allen, wirklich allen Dimensionen unserer Gesellschaften und unseres Lebens: automatische Transportsysteme, Lieferkettenlogistik, Roboter aller Art, Sprachprogramme, die Texte aller Sorten analysieren oder herstellen. Das Tempo der Veränderungen ist rasant. Internet, Smartphone und "lernende Systeme" haben in drei Jahrzehnten die Wirtschaftsordnung, die globalen Austauschbeziehungen und den Alltag durchdrungen und umgewälzt.

II.

Im Oktober 2022 zog an eben dem Ort, wo Leibniz vor mehr als dreihundert Jahren das binäre Rechnen entwarf, im Schloss Herrenhausen in Hannover, eine Konferenz der VolkswagenStiftung eine Zwischenbilanz zum Verhältnis von Künstlicher Intelligenz (KI) und Gesellschaft: "AI and the Future of Societies". Naturgemäß eine fragmentarische Veranstaltung, denn Prognosen beim Abwägen von "Herausforderungen und Risiken" der IT-Entwicklung werden regelmäßig in Jahresfrist zu Makulatur.

Erstaunlich ist das schon: siebzig Jahre nach dem IBM 650, fünfundvierzig Jahre nach dem Apple 1 und 15 Jahre nach der Marktreife von Smartphones ist der Reiz von Dystopien immer noch nicht verblasst. Was mit dem "autonomen Fahren" gerade beginnt, das könnte, so der Philosoph Roberto Simanowski in seinem Eröffnungsvortrag, in eine Gesellschaft führen, in der Algorithmen nicht nur den Verkehr regeln, sondern politische, soziale und ökonomische Entscheidungen treffen (siehe auch "Todesalgorithmus. Das Dilemma der künstlichen Intelligenz"). Gerade die komplexen Problemlagen von Klimawandel, Ressourcenknappheit und gesellschaftlichen Polarisierungen wären, wenn überhaupt, nur mit Überwachung, zentralisierter Logistik und automatisierter Zuteilung von Lebenschancen zu bewältigen. "Die KI ergreift die Macht über den Menschen, aber nur, um ihn vor dem selbstverschuldeten Untergang zu bewahren". Das Anthropozän, das Zeitalter der Menschen, wäre dann die Vollendung eines Aufbruchs, der mit dem Griff nach der Erkenntnis begann und mit der automatisieren Ökodiktatur endet. Das Bedürfnis nach Sicherheit und "Zähmung des Ungewissen", das von jeher die Zivilisation antreibt, würde so in "die Selbstentmachtung des Menschen durch sein eigenes Geschöpf" führen. In die Transformation des homo sapiens:

Es sind eher Digitalphilosophen, Designer, Trendforscher und kalifornische Milliardäre, die an dieser Möglichkeit einer mit Weltdaten gefütterte Universalintelligenz arbeiten – oder an der Idee von ihr. Technisch sind wir weit entfernt von einem solchen Master Algorithm, und wahrscheinlich wird er in alle Ewigkeit eine Phantasie bleiben. Auch das autonome Fahren wird noch nicht in der nächsten Zukunft Wirklichkeit werden – wenn überhaupt. Zur Zeit, so versicherte es eine kundige Informatikerin in einer Kongresspause, hätte die KI noch Einordnungsprobleme, wenn eine alte Frau mit einem Fahrrad über die Straße geht.

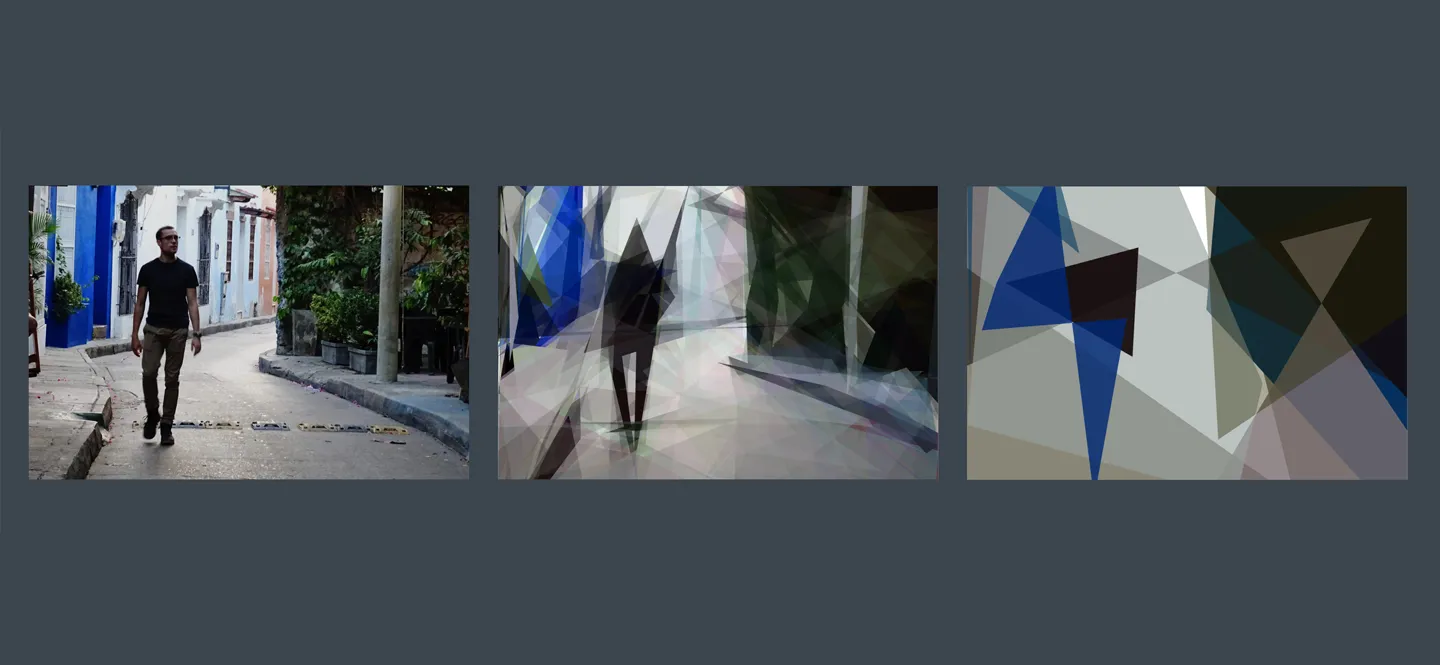

Die Arbeit veranschaulicht ein Modell für maschinelles Lernen: den Entscheidungsbaum. Entscheidungsbäume funktionieren, indem sie die Daten in immer kleinere Segmente aufteilen. Hier wurde ein Modell trainiert, um Pixelfarbwerte basierend auf einem Originalfoto vorherzusagen.

In der Grauzone unserer Gegenwart haben wir es bis auf weiteres "nur" mit chinesischen Überwachungssystemen (oder dem, was wir über sie lesen) zu tun, mit der Rationierungs- und Automatisierungswelle von Arbeit 4.0, mit dem Nutzen und den Kollateralschäden der sozialen Medien, mit privatwirtschaftlich betriebenen Satellitensystemen, bewaffneten Drohnen, Logistikplattformen mit prekären Tagelöhnern und Franchisenehmern, kommerziellen Datenhändlern, elektronisch gesteuerten ("smarten") Geräten aller Art – und, an der Grenze der Menschlichkeit, mit Avataren teurer Toter, die den Nachfahren in dreidimensionaler Präsenz aus ihrem Leben erzählen oder Ratschläge und Trost spenden.

Aber "wie immer" würde Leibniz sagen, "geht die Gegenwart mit der Zukunft schwanger". Und aus dieser Gegenwart lassen sich Tendenzen ablesen. Aber Aufklärung, die sich über sich selbst aufklärt, organisiert sich als Arbeit; und Ängste werden nur bearbeitbar, indem man sich ihnen stellt. Totalsichten, schon gar die auf dystopische Endzustände, lähmen die soziale Phantasie. Wenn die digitale Zukunft human und demokratisch gestaltet werden soll, hilft nur die mühselige Auseinandersetzung mit Einzelheiten.

Wie immer geht die Gegenwart mit der Zukunft schwanger.

Die aber tut Not, denn was da – ungleich schneller als der Buchdruck, die Dampfmaschine und der Elektromotor – in die Welt tritt, wird das Skelett und das Gewebe unserer Gesellschaften stärker verändern als alle technischen Revolution vor unserer Epoche des Übergangs.

III.

"Wo aber Gefahr ist, wächst das Rettende auch" – Geschichtsmetaphysiker könnten in Versuchung sein, zu glauben, die Gleichzeitigkeit von Klimakatastrophe und digitaler Revolution sei kein Zufall. "Wenn es gelingt, die digitalen Umbrüche in Richtung Nachhaltigkeit auszurichten, kann die Wende hin zu einer nachhaltigen Welt gelingen." So beginnt das 500 Seiten starke Gutachten "Unsere gemeinsame digitale Zukunft, das der "Wissenschaftliche Beirat globale Umweltveränderungen", kurz WBGU, 2019 der Bundesregierung übergeben hat.

Ohne Computer, ohne die Analysekapazität von "Big Data" wäre die Verfolgung und Dokumentierung der Klimakatastrophe nicht möglich. Satelliten vermessen den Schwund von Regenwald, und können illegale Anpflanzungen entdecken. Algorithmen berechnen den Artenschwund und steuern den effizienten Umgang mit Rohstoffen und gesellschaftliche Stoffwechselprozesse. "Smarte" Versorgungssysteme können in Städten den Energiehaushalt steuern, meteorologische Modellrechnungen Sturmwarnungen verbessern und Katastrophen verhindern, in denen Roboter aufräumen. Soziale Netzwerke können zur Aufklärung beitragen. "Das alles klingt gut," so resümierte es auf der Herrenhäuser Tagung Grischa Beier vom Potsdamer Institut für transformative Nachhaltigkeitsforschung (IASS). Vieles davon geschieht, aber die Organisation einer koordinierten, gesamtgesellschaftlichen, gar globalen ökologischen Transformation, einer terrestrischen Apollo-Mission gleichsam, deutet sich noch nicht an. Mehr noch: die Wirkung dieser "rettenden" oder bewahrenden Techniken wird mehr als neutralisiert durch ein beschleunigtes konventionelles Wachstum von Warenproduktion und Konsum. Einstweilen, so der WGBU, wirken die digitalen Techniken durch ihre produktivitätssteigernde Funktion eher wie "Brandbeschleuniger von Wachstumsmustern, die die planetarischen Leitplanken durchbrechen" (WGBU). Dazu kommt noch die Emissionslast, die durch die Technik selbst verursacht wird: So verbraucht allein die Produktion eines Smartphones 89m3 Wasser; der weltweite Datenverkehr im Internet benötigt jetzt schon geschätzte 10 Prozent des globalen Stromverbrauchs; die Datenmenge verdoppelt sich, vor allem durch Streaming, Gaming und Clouddienste alle 18 Monate; Rechenzentren gehören zu den Top 10 bei den industriellen Wassernutzern, in Frankfurt könnte ihre Abwärme die gesamte Stadt heizen.

IV.

Die Zwänge sind nicht technisch. Roboter, digitale Entscheidungstechniken, lernende Systemen sind nicht autonom. Das technisch Machbare wird gesteigert – aber es geschieht zumeist innerhalb der alten Strukturen. "It’s the economy, stupid." Und das gilt auch für die periodisch verstörenden Meldungen über die kommende Massenarbeitslosigkeit. Mit heller Nüchternheit zieht Marija Slavkovik, die an der Universität Bergen Informatik und Medienwissenschaft lehrt, Bilanz: "Die harte und langweilige Arbeit unserer Eltern und Großeltern verschwindet" - und das sei doch nicht schlecht, so Slavkovik. Nirgendwo würde auf einen Schlag die Gesellschaft durchautomatisiert, es sei ein Prozess, in dem Zeit für die Einführung von Kompensationen bleibt, wenn wir sie nutzen, durch Arbeitszeitverkürzung, durch Grundeinkommen. Und schließlich schaffe die Digitalisierung selbst neue Berufe. Zum Beispiel SEOs, Search Engine Optimizer, die Slavkovik als Beispiel nennt. Das sind technisch nachgerüstete Marketing-Experten, die dafür sorgen, dass ihre Kunden möglichst auf Seite 1 bei der Google-Recherche stehen, ob es nun um Waschmittel oder wissenschaftliche Bücher geht. "Die mag ich besonders gern", lacht Slavkovik ironisch. "Was mir allerdings Sorgen macht, ist die Machtverschiebung. Wenn die U-Bahnen automatisch fahren, verlieren die Gewerkschaften Verhandlungsmacht." Da müsse gegengesteuert werden, vor allem aber: "Wir müssen alle miteinander klüger werden, jeder einzelne von uns." Müssten lernen, zwischen Fakten und den Äußerungen der neuen Twitter-Superhelden und Influencer wie Trump oder Musk zu unterscheiden.

Wir müssen alle miteinander klüger werden, jeder einzelne von uns.

Und wenn der Markt und die Sozialen Medien es nicht schaffen, Hate Speech, und andere Kollateralschäden der "Sozialen Medien" zu regulieren, dann müsse eben die Politik tätig werden. Mit ihren Studenten hat sie über die Notwendigkeit eines neuen "journalistischen Gesellschaftsvertrags" diskutiert. Zukunftsvisionen? Slavkovik redet eher von Folgeaufgabe, die uns der Fortschritt beschert hat, und mit der er uns beschwert. Wir müssten eben lernen, zu balancieren: die Verluste – etwa an direkter Nähe – und die Gewinne – uns mit Menschen zu verbinden, die weit weg von uns dieselben Interessen oder Ziele habe im Verhältnis zu sehen. Wie sie es mit der Zukunft des homo sapiens halte, frage ich sie – in der digital ermöglichten Nähe und Konzentration eines ZOOM-Gesprächs auf 2000 km Entfernung. Ob sie nicht die Sorge teile, dass immer mehr produktive und kreative Fähigkeiten in die Maschinen wandern und nicht mehr an den Menschen haften? "Nein, es wird immer weiter noch Fachwissen benötigt, um diese Systeme zu bedienen, wenn sie funktionieren sollen." Optimismus, Pessimismus? "Ach, heute erwischen Sie mich als Optimistin, morgen bin ich vielleicht wieder skeptisch."

V.

Es gibt keinen Selbstlauf der Technik. Es führt kein direkter Weg vom Faustkeil zur Atombombe. Die Mustererkennung bei der Auswertung von Röntgenfilmen oder CT-Bildern beruht auf derselben Basistechnologie wie die Gesichtserkennung zur Überwachung von Problembezirken oder Tankstellen, wie die Zielerkennung von Drohnen, die Terroristen oder Gaspipelines gezielt ausschalten oder Lebensmittel abwerfen. Ob und wie dieses Leben erhaltende neue Werkzeug in der Krebstherapie eingesetzt wird, das hängt von ökonomischen Erwägungen, von der Überwindung eingeübter Routinen und von den Finanzierungsformen des Gesundheitswesens ab. Pilotprojekte auf diesem wie auf anderen neuen Anwendungsgebieten für KI gibt es viele. Auch die VolkswagenStiftung fördert sie. Unter anderem diese zwei wurden hier vorgestellt: In Berlin und Brandenburg werden die Unterlagen von Patienten mit Prostatakrebs in der Charité ausgewertet (Individualising & democratizing cancer patient care via Artificial Intelligence: trans-disciplinary solutions & normative considerations). Dort arbeiten die Wissenschaftlerinnen und Wissenschaftler mit den neusten wissenschaftlichen Erkenntnissen und avanciertesten Apparaten; und von dort aus werden den niedergelassenen Ärzten in der Provinz Diagnosen und Therapievorschläge zugeleitet. "Demokratisierte Hochleistungsmedizin", sagt dazu das Team, in dem ein Chefarzt, ein Bioinformatiker und eine Juristin zusammenarbeiten.

In München untersucht Susanne Gaube, wie Ärzte unterschiedlich auf Empfehlungen reagieren, je nachdem ob sie von erfahrenen Spezialisten kommen oder computergeneriert sind, aber auch: ob die Expertensysteme der KI zu falschem Vertrauen auf Technik führen (Human-AI-Interaction in Healthcare: Identifying Factors Contributing to Clinical Utility). Die Anwendung von KI ist ein soziales Gesamtphänomen; Technikvertrauen, Skepsis, konservatives Beharren, finanzielle Zwänge oder liberale Dogmen und vieles mehr bestimmt die Richtung. Könnte die Entwicklung auf eine von Amazon, Google unterstützte, von Investoren oder etablierten Medizinmultis gekaperte Privatisierung des Fortschritts hinauslaufen? "Nicht unwahrscheinlich", so der trockene Kommentar einer Forscherin. Der Lobbydruck auf einen Markt, der in reichen und überalterten Gesellschaften große Profite verspricht, sei spürbar, in Europa sogar stärker spürbar und noch dazu weniger stark reguliert als in den USA. Die schnellen Erfolge der Impfstoffentwicklung beruhen auf wissenschaftlicher Kreativität, Big Data und Anfangskapital. Der globale Nutzen des Erfolgs wird durch internationale Patentgepflogenheiten eingeschränkt.

VI.

Techniker, also auch Informatiker, sind in ihre Versuchsanordnungen, ihre eleganten Lösungen und ins Gelingen verliebt. Das gilt auch für die Technikfolgen-Forscher, die mit trickreichen Untersuchungen die Schwachstellen von KI-Systemen aufspüren, die sozialen, biologischen, psychologischen und geschlechtsbezogenen Vorurteile, die sich in die Software der Sozialbehörden einschleichen – und die (so eine auf diesem Kongress demonstrierte Studie) regional, national oder sozial verschieden ausfallen. Was wiederum gegen ungeprüfte, global vermarktete KI-Systeme spricht, wie sie schon bei der Zuteilung von Sozialleistungen eingesetzt werden. Einfallsreich auch die computergestützte Nachverfolgung der Verlaufsmuster von radikalen Äußerungen, Obszönität oder Fake News in den "Sozialen Netzen", die Untersuchung altersspezifischen Nutzer-Gewohnheiten, oder die Frage, welche psychologischen Folgen Sprach-Chatbots haben, mit denen einsame Menschen mit virtuellen "Freunden" oder "Freundinnen" ihre langen Abende aufhellen wollen.

Mit solchen Untersuchungen läuft die Erforschung der Technikfolgen auf Dokumentation von Kollateralschäden und Schadensbegrenzung hinaus. Aufs Hinterherputzen also. Sozialtherapeutische Vorschläge wie der, auf automatisch erzeugte und gestreute Hassbotschaften oder personalisierte Werbung mit ebenso automatisch erzeugten Gegenbotschaften, virtuellen Gesprächsangeboten oder freundlichen Hinweisen zu reagieren (Bots Building Bridges (3B): Theoretical, Empirical, and Technological Foundations for Systems that Monitor and Support Political Deliberation Online), kommen mir zu kleinteilig vor, zu handwerkelnd und viel zu fein gesponnen angesichts der Brutalität und Massivität von Fake News und pornographischen Lockspeisen.

Es sind end-of-the-pipe-Kontrollen, die nicht einmal die schlimmsten und kriminellen Auswüchse erfassen können...

Es sind end-of-the-pipe-Kontrollen, die nicht einmal die schlimmsten und kriminellen Auswüchse erfassen können, und schon gar nicht reichen sie aus, die Blasen und Schaumstruktur, die sich an die Stelle einer halbwegs organisierten und überschaubaren Öffentlichkeit gesetzt hat, aufzulösen. An dieser Stelle wäre es hilfreich, wenn Wissenschaftler und recherchierende Journalisten ihre unterschiedlichen Formen der Wirklichkeitsuntersuchung kombinieren würden, das wäre eine Multidisziplinarität, die Aufklärung breiter und schmerzhafter machen könnte.

VII.

Regulierung tut Not und wird von den Politikern in zähen Prozessen nachgereicht, aber "die Speerspitze der Entwicklung ist in privaten Händen. Wir haben verpasst, den Prozess zu steuern. Wir haben nichts gelernt aus der Geschichte der Atomkraft", sagt Grischa Beier. "Digital first, Bedenken second" (Slogan der FDP) – der flotte Spruch war wohl nie richtig, im Wahlkampf 2021 war er antiquiert. Der Staat, und unserer mehr als andere, hat sich "als Bauherr der digitalen Gesellschaft verabschiedet", so der deutsche Journalist Niklas Maak. Eine "Straßenverkehrsordnung" für diese neue gesellschaftliche Öffentlichkeit ist nicht rechtzeitig verfasst worden, an eine Vergesellschaftung der Kommunikationsmonopole und virtuellen Markplätze und Autobahnen denkt keiner mehr außer Feuilletonisten. Der Zeitpunkt für die Möglichkeit, die Entstehung und Verbreitung von Rassismus, Hate Speech, Sexismus und Lügen an der Quelle zu verhindern – etwa mit der Pflicht zu einem Klarnamen-Impressum - ist vor Jahrzehnten versäumt worden: Liberalisierung first ,Bedenken second. Und nun sind die digitalen Markt- und Meinungsplätze, ob nun zum Handeln, zum Debattieren, zum Informieren und zum Amüsieren, fest in der Hand der großen Vier: Google, Amazon, Facebook, Apple und der von ihnen angebotenen oder verbreiteten Apps. Und das weltweit, jedenfalls überall, wo autoritäre Staaten keine Firewalls bauen. Sicher, soziale Bewertungssysteme, wie sie aus China gemeldet werden, wird es bei uns auf absehbare Zeit nicht geben, und die US-amerikanischen Erfahrungen mit Algorithmen, welche die Rückfallwahrscheinlichkeit von Straftätern berechneten, verstärken die Vorsicht, und die Spracherkennungs-Software von arabischen Dialekten, vermittels der das BAMF die Herkunft von Asylbewerbern klären will, funktioniert offenbar auch nicht richtig. Und das heißt: Vergleichende Forschungen wie die auf der Konferenz vorgestellten und aktive NGOs wie AlgorithmWatch tun auch weiterhin Not, wenn wir Bürger unsere Souveränität, wenn die Gesellschaft als Ganze ihre Grundwerte nicht preisgeben wollen.

Nationale Regulierungsbestrebungen wie die Datenschutzgrundverordnung und der EU-Entwurf einer "Digitale Dienste-Verordnung" sind einerseits überkomplex - dies beschränkt die öffentliche Diskussion auf Experten oder grobe Vereinfacher. Was aber Not täte, und was mehr als juristische oder technische Diskussionen anzetteln könnte, wäre eine Auseinandersetzung über "Sektorale Lösungen", so Matthias Spielkamp von AlgorithmWatch. Über die Frage also, welche Bereiche unseres Lebens wir digitalisieren, und das heißt rationalisieren lassen wollen: den Grundschulunterricht? Die Zuteilung zu Schulbezirken? Die Interviews zur Einstellung? Den Gasverbrauch? Welche wir mit digitalen Techniken demokratisieren, vereinfachen oder vergemeinschaften könnten: Steuerbescheide, öffentliche Statistiken, Katasterdaten, Erkenntnisse staatlich finanzierter Forschungen, Streaming subventionierter Kulturveranstaltungen etc. etc. Und welche auf keinen Fall. Zwei Stunden Anhörung in einem Bundestagsausschuss mit sparsamer Berichterstattung danach dürften kaum angemessen sein, um die Probleme, aber auch die Chancen der KI in einer gesellschaftlichen Debatte zu erörtern. Jedes Jahr, jeden Monat verpassen wir so dringende Weichenstellungen. Hätte diese technische Zeitenwende nicht mindestens ebenso viel demokratische Leidenschaft und bürgerschaftliche Expertise verdient wie zu seiner Zeit die Atomenergie?

Sicher, Kontrollen werden nachgereicht – wie etwa der EU-Entwurf einer "Digitale Dienste-Verordnung", der in vielen der Vorträge kommentiert wurde. Schon sein der Titel verrät, was dieser "harmonisierenden" europäischen Regelung allenfalls möglich erscheint: Anwendungen, die "ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte natürlicher Personen darstellen", werden einer strengen Aufsicht unterstellt werden, also etwa die Bewertung von Bewerbungsunterlagen oder die Zuteilung von spezifischen Sozialleistungen. Subjektive, also einklagbare Rechte werden geschützt; der Schutz des sozialen Zusammenhalts ist nicht vorgesehen.

Soziale Netzwerke als solche gelten nicht als riskant, nur justiziabler Missbrauch in ihnen.

Soziale Netzwerke als solche gelten nicht als riskant, nur justiziabler Missbrauch in ihnen – der gesellschaftliche Schaden wird bedauernd hingenommen: die Funktionsweise dieser Systeme müsse den Nutzern bewusst sein. Kontrolldenken setzt beim Schaden für die einzelnen an, der gesellschaftliche ist nicht zu messen. Google, Facebook, WhatsApp, Instagram und ihre kleinen Konkurrenten haben die alte Öffentlichkeit von Rundfunk, Fernsehen und Presse aufgesogen. Die Langzeitfolgen sind spürbar, aber es ist noch nicht abzusehen, wie sehr sie sich noch steigern können. Korrekturen an diesem Strukturbruch halten die Parlamentarier nicht mehr für möglich, die US-Unternehmen seien nicht mehr einzuholen; so soll das europäische Internet, über das jetzt wieder gesprochen wird, vor allem der militärischen und wirtschaftlichen Sicherheit dienen. Das führt zu Folgefragen: Wie lange werden Whatsapp-Gruppen mit 256 Teilnehmern noch durch das Fernmeldegeheimnis geschützt bleiben?

VIII.

Souveränitätsverlust ist die politische und soziale Signatur dieser hightech-kapitalistischen und geopolitischen Zeitenwende. Bei den digitalen Netzen, terrestrisch wie satellitengestützt, ist die technische Dominanz der US-basierten großen Provider und Cloud-Betreiber nicht mehr aufzuholen; die netzbasierten kommerziellen Dienstleister treiben global die Enteignung des Mittelstandes voran; Europa ist nicht in der Lage, an europäischen Werten und Interessen orientierte Infrastruktur aufzubauen.

Dramatischer ist die technologische und ökonomische Ungleichheit zwischen den reichen Ländern des Westens und China einerseits und den armen, postkolonialen Gesellschaften des Südens. Informationssoziologisch gesprochen sind dies oft Gesellschaften mit "low ressource languages", in denen nicht genügend Text-Daten oder Sprachgaben zum Training von sprachbasierten Apps oder maschinellen Übersetzungsprogrammen vorliegen. Aber von den 7000 Sprachen der Erdbevölkerung sind nur 20 "ressourcenreich", also reif für (rentable) Programmentwicklung, und das heißt: sie sind auf die Software aus dem Norden der Welt angewiesen. In weiten Regionen der Erde können Menschen auch für einfache Dienstleistungen nicht auf Apps in ihrer Muttersprache für Banküberweisungen, für medizinische Versorgung, für den Transport oder den Aufbau kommerzieller oder sozialer Netzwerke zugreifen, geschweige denn, die Bildungsangebote zum beruflichen Training, zu neuen Anbaumethoden, der Vermarktung landwirtschaftlicher Produkte.

Initiativen, die mit finanzieller Unterstützung von Regierungen oder Stiftungen aus den reichen Ländern (bei uns ist es die GIZ) diese Lücke zu schließen trachten, kritisieren gleichzeitig den "Digitalen Kolonialismus". Software-Programme und Netzwerke, die der Entwicklung der Zivilgesellschaft dienen, und dabei auf regionalen Sitten und Solidaritäten aufbauen, werden, sobald sie erfolgreich sind, oft von großen internationalen Konzernen "gekapert" und kolonialisiert; in vielen Regionen sind Mikrokreditprogramme, die auf den auf sozialen Netzwerken und traditionellen Solidaritäten ruhten, inzwischen zu Nebenerwerbsschauplätze für Großinvestoren geworden. "Datenimperialismus" – das Wort fiel oft auf der Herrenhäuser Konferenz: Die großen Digital-Konzerne schürfen nicht nur nach mineralischen Rohstoffen für die Computerproduktion, sondern auch nach menschlichem Rohstoff für Software: an Küchentischen in Lateinamerika und Afrika werden die Bilder ausgewertet, mit denen die KI für autonomes Fahren oder Applikationen trainiert werden, Facebook bietet im Süden des Globus einen "Internet-Zugang für arme Menschen" und verkauft dafür weltweit die Daten seiner Nutzer. "Wenn Ihr die Zukunft Eurer Gesellschaften sehen wollt", rief die Digitalaktivistin Beatriz Busaniche aus Argentinien ins Auditorium, "dann schaut Euch die Geschichte unserer Region an". Es ist die Geschichte der Dominanz transnationaler Konzerne, die Geschichte der abhängigen Entwicklung, der Ausbeutung (siehe unter Fundacion Via Libre).

Es gibt noch einen anderen, einen anthropologischen Souveränitätsverlust: Gegen Ende der Tagung im hannoverschen Schloss erzählte Adekemi Omotubora, eine nigerianische Juristin und Aktivistin für digitale Inklusion, von einer Frau in einer abgelegenen Gegend des Landes, die panisch erschrak, als sie gebeten wurde, eine Sprachprobe für eine Sprach-App zu geben. Sie weigerte sich und sagte: "Ich weiß ja nicht was mit meiner Stimme gemacht wird, wenn ich sie weggebe." Das klingt nach Aberglauben, aber es ist die Quintessenz aus dem, was der französische Anthropologe André Leroi-Gourhan die Geschichte der Exteriorisierungen nennt: Die Gattung homo sapiens hat ihre Fähigkeiten ins Gigantische gesteigert durch Entäußerung in Werkzeuge, Maschinen, soziale Systeme. Der Preis ist das Schrumpfen der Einzelnen. Souverän ist, wer diese Systeme besitzt. Als Individuum – oder als Gesellschaft.

IX.

Computer sind "Werkzeuge der Befreiung", schrieb 1974 der Kybernetiker und Management-Theoretiker Stafford Beer. Sie nehmen mühselige Arbeit von uns. Sie erweitern unsere kognitiven und explorierenden Fähigkeiten. Damit erweitern sie unsere Wahlmöglichkeiten. Sie ermöglichen Vorausschau und erleichtern Entscheidungen. Dieser Prozess heißt Planung. Planung sichert unsere Freiheitsräume. Designing Freedom fängt damit an, dass wir Alternativen berechnen können, im Kleinen und im Gesellschaftsmaßstab. In diesem Jahrhundert geht es darum, Alternativen zu entwerfen zu unserer Art der Produktion, die uns wohlhabend gemacht hat und am Ende in die Wachstumsfalle hat laufen lassen, in die Sackgassen des Klimawandels und der Rohstofferschöpfung – und in moralisch untragbare globale Ungleichheiten.

"Wenn wir den Markt nicht durch den Plan ersetzen", so sagte es Jens Schröter auf der Tagung im Schloss Herrenhausen, "wird die Zerstörung nicht aufhören. Wir müssen downsizen, wenn wir den Planeten retten wollen".

Wir müssen downsizen, wenn wir den Planeten retten wollen.

Mit einer interdisziplinären Gruppe forscht Schröter an der Frage, wie eine Gesellschaft ohne Geld funktionieren könnte (Die Gesellschaft nach dem Geld - Eine Simulation). Die liberale Wirtschaftslehre ging davon aus, dass es keine bessere Möglichkeit gibt, die Informationen zu sammeln, die eine Gesellschaft braucht, um ihr Leben und Überleben zu organisieren, als Geld und Märkte. Orthodoxe Ökonomen behaupten immer noch, dass Geldströme die effizienteste Form der Information seien. Nach den Krisen der letzten Jahrzehnte, und angesichts der Klimakatastrophe scheint das im Zeitalter von Supercomputern und Steuerungsalgorithmen antiquiert zu sein. Wirtschaftliche Stabilität erfordert Planung. Walmart, Amazon, Uber, Siemens, die chinesische Regierung – sie alle planen, nach innen und nach außen, um zu bestehen und zu wachsen. Drei Männer auf den Mond zu bringen ging nur mit Planung. Um nicht die Welt zu zerstören, brauchen wir Planung – demokratische Planung.

Gegen Ende der Herrenhäuser Tagung fragte ein älterer Herr auf der öffentlichen Podiumsdiskussion, ob die KI uns sagen könne, ob wir die zehn Milliarden ernähren könnten, die wir demnächst seien. Ja, war die Antwort; im Prinzip könne sie auch sagen, was zu tun wäre. In einer Strategie des ökologischen Umbaus und des Rückzugs aus unhaltbaren Positionen ist KI ein Werkzeug der Befreiung. Eine emanzipierte Gesellschaft hätte die Mittel, um vorher auszurechnen, was die Folgen wären, wenn wir – nur zum Beispiel – die Fleischproduktion in Westniedersachsen reduzieren wollen: für den Boden, für den Landkreis, für das Steueraufkommen, für die Agrarstruktur in einigen afrikanischen Ländern. Planungsalgorithmen könnten ausrechnen, wieviel Lehrer wir brauchen, um den Bedarf der Wirtschaft zu stillen, und wie viele, um das Recht auf gleiche Bildungschancen zu verwirklichen, könnten die Kosten kalkulieren, damit es in den Pflegeheimen menschlich zugeht. Entscheidungsalgorithmen könnten Vorschläge machen, auf wie vielen verschiedenen Wegen man das erreichen kann. Einigen müssen wir uns dann allerdings selbst: auf die Grundwerte, die in die Rechnung eingehen sollen, und über den Weg, den wir einschlagen wollen.

X.

Algorithmen werden von Menschen, nicht von Maschinen programmiert. Bewusst oder unbewusst gehen so menschliche Fähigkeiten, Intelligenz und Erfahrungen in sie ein. Wir müssen sie kennenlernen, wenn wir nicht ihre Objekte werden wollen. Wenn sie uns nicht enteignen sollen, müssten wir die Maschinen in die Hand nehmen, zumindest aber an die Hand. Das setzt viel voraus, vor allem die Verbindung von technischer und sozialwissenschaftlicher Intelligenz. Ingenieursmäßige Tugenden und bürgerliches Selbstbewusstsein. Erstaunlich eigentlich, dass es in Deutschland nur einen Studiengang für Sozialinformatik gibt, in dem beides von Anfang an zusammengedacht und geplant wird.

XI.

"Denkt man sich etwa eine Maschine, die so beschaffen wäre, daß sie denken, empfinden und perzipieren könnte, so kann man sie sich derart proportional vergrößert vorstellen, daß man in sie wie in eine Mühle eintreten könnte. Dies vorausgesetzt, wird man bei der Besichtigung ihres Inneren nichts weiter als einzelne Teile finden, die einander stoßen.” (Leibniz, Monadologie, § 17>>>>).

Mit anderen Worten: Im Innern der Künstlichen Intelligenz begegnen wir uns selbst.

Informationen zur Veranstaltung

AI and the Future of Societies

During this Herrenhausen Conference, recent and future developments in research and application of artificial intelligence (AI) and their impact on societies are to be discussed.

The dynamic developments in research and application fields of artificial intelligence (AI) are about to fundamentally change societies. AI is increasingly permeating all areas of life. This concerns global issues, such as sustainable system transformation or use of self-learning algorithms in work environments and public administration, as well as areas of private life, such as care for the elderly or individual learning. Simultaneous to the manifold opportunities associated with the use of AI, this development poses enormous challenges and risks. Questions arise for all societies as to what effects can be expected in the further course of the digital revolution.

In the context of this Herrenhausen Conference, central aspects and application areas of artificial intelligence will be discussed from an interdisciplinary perspective. What effects can be expected for political and economic systems? What are the consequences, for instance, for the future of mobility, labor relations and, not least, social inequality at different levels? The challenge of the future for all societies is: How can people use AI applications for their benefit and how can all parts of societies participate in the benefits of AI?

Herrenhausen Conference

AI and the Future of Societies

October 12 - 14, 2022

Herrenhausen Palace, Hanover, Germany